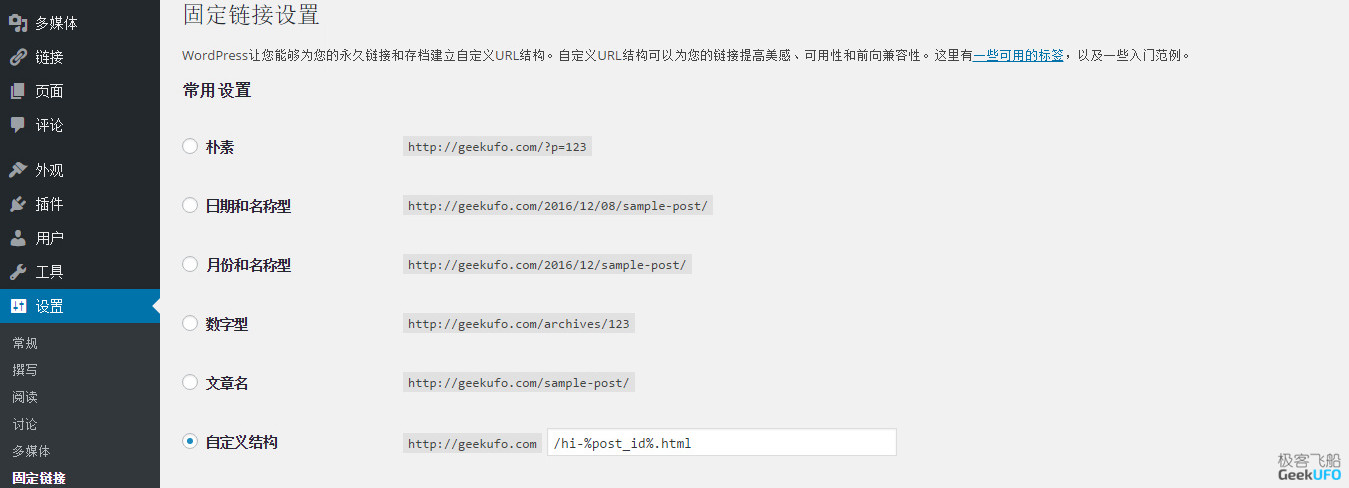

一、简洁的固定链接

固定链接能让每篇文章的 URL 变成有固定规律可循的格式,比如:http://域名/分类名/文章名

WordPress 的设置在后台「设置」-「固定链接」,在 官方文档 里可以还找到供自定义的参数,我观察到 %postid% (文章唯一ID)这个参数多受站长欢迎,原因是 postid 即使文章在发出后更新也能保持不变,极客飞船也使用了该参数。

理论上你可以按自己的喜好随意组合,但文章链接这东西,会被收录、被分享,来访的读者也可能会瞄上几眼,层级太多或链接过长都是糟糕的事,所以应当秉持“去复杂化”,对于 SEO 这里就有一些要注意的点:

-

固定链接的变动也会让已收录的文章 URL 变动,造成收录死页,并产生搜索引擎惩罚(认为网站不稳定),所以一般都是建议:慎重决定一次设好;

-

%postname% 参数会将标题中的中文转换成很长的 URL 编码,很长很长,所以对于国内网站的普适性并不好,要使用这个参数就得采取一些手段。解决办法:在官方库中可以找到一款名叫 Pinyin Permalink 的插件,该插件可以将文章名转换成拼音;

-

默认情况下 WordPress 会在域名后面,强行加入一个叫 /category 的路径,而且只能修改不能删除,也是搞不懂的逻辑。继续祭出插件大法,使用插件 WP No Category Base 可清除。

什么,光一个固定链接设置就用了 2 个 插件?插件用多了难到不会拖慢服务器性能?

那就不用 %postname% 参数咯,简短点用 %postid% 没什么不好,![]() 开个玩笑

开个玩笑

关于插件的数量,其实不用在初期不用太担心,小体量的插件对网站性能的影响微乎其微,而 WP-Super-Cahce、Akismet 这样体量稍大的插件也是利大于弊,事实上,就连大牛张戈以前也在一篇博文中说过自己有使用 9 个插件。极客飞船的插件数量近似,根据我对服务器资源占用的观察,待机情况下除了 RAM 占用提高了几十M,CPU 使用率一般不超过骰子的最大数(这博客是有多人迹罕至啊![]() 还请大伙不吝点赞。)

还请大伙不吝点赞。)

二、到底要不要加.html(伪静态)

伪静态相对之于静态,在网页设计中什么是静态文件呢?通常见到的 html 格式的文件就是一个静态网页,在浏览器中打开后无论怎么操作都不会产生永久性改变,关闭再重新打开还是呈初始状态,它的一个重要特征就是可以离线访问。

假如我做了一个名为“关于本站.html” 的文件上传到网站根目录,并在主页提供了一个名为“关于本站”的入口,那么搜索引擎就有可能收录这个静态页面。

但 WordPress 网站是采用 PHP 编写,并且必须连接数据库才能访问的,在固定链接结构的尾部加入 .html 并不会真的使网页变成纯粹的静态文件,所以谓之:伪静态。

有什么用呢?据说早期的搜索引擎,对静态页面的收录会比动态网页更加快速,但技术在发展,搜索引擎更智能更全面即是趋势也是事实。

其实在 Wordpress 官方文档的「小贴士和小技巧」一栏中,也对以 .html 结尾的做法进行了描述:

需要注意的是,这并不会生成静态的html档,仅仅是用.html作为尾码,页面还是动态生成的。这是否会给SEO带来好处还无定论,但是当你想从WordPress搬家时,将带来很多便利,因为所有页面可以很容易地变成静态的,而且位址不用改变。

听起来就是「没什么卵用」,你看姬十三的科学松鼠会(没错,网站是WP做的)加了吗?

如果说卢松松加了,可能是因为 8 年前年代久远;说张戈加了,可能是 2 年前他被忽悠了;而我铁定是在纯小白时期被伪静态的伪高大上忽悠了。

私以为,专注于网站的其他方面远胜过这个鸡肋的旁枝末节。

三、制作 Sitemap 站点地图和 Robots 协议

Sitemap 站点地图,是一个告诉搜索引擎蜘蛛可供爬取的网址合集,通常是放在网站根目录的一个 xml 格式文件,搜索引擎更喜欢有 Sitemap 的网站;

Robots 协议也称为爬虫协议、机器人协议等,作用是告诉搜索引擎哪些页面可以抓取,哪些页面不能抓取,有点像蜘蛛的路标,通常是放在网站根目录的一个 txt 格式文件,标准的文件名称应为:robots.txt

Sitemap 的制作我推荐直接使用插件:XML 站点地图 & 谷歌新闻订阅源,在 WP 插件官方库中可以搜索到,该插件除了自定义和生成已有的页面链接,还能在每一次发布新文章后自动更新 sitemap.xml 文件。

Robots 协议则更加重要,没有定义好的话可能会限制蜘蛛的正常行动,造成搜索引擎的负面评分,而且这里的蜘蛛并不是只针对收录文章的蜘蛛,还有像 谷歌移动设备适应性测试 这样的蜘蛛容易被遗忘。想要兼顾良好的引导和限制效果,网站管理者有必要根据网站实际需求,合理组织协议规则。

极客飞船的 Robots 协议曾花掉了我一个下午苦想和检验,所以 Ricky 觉得还是有一定的参考价值,考虑到这份 robots.txt 规则有点长,我另起了一文,有兴趣看我是如何考量和权衡的朋友请移步:乱侃Robots协议(robots.txt)

懒人可以点这里:robots.txt

四、设置好 301 跳转

如果网站域名只使用带 www 和不带 www 其中一种的话,就要妥善处置好另一个。虽然不带 www 的网站越来越多,但在访问前习惯输入 www. 的用户仍不在少数,用户习惯可以培养,但不可以挑战,偷懒只解析一个主机类型不是值得称赞的做法。

这种情景下,站长应该尽快决定「主域名」带不带 www,然后将另一个设置成 301 跳转,以达到网址统一和权重传递的目的,具体设置方法在:配合CDN进行301跳转完美隐藏源站IP

五、接入各大站长平台

完成以上工作后别忘了注册各大站长平台的账号,它们分别是:百度站长平台、360站长平台、搜狗站长平台、谷歌站长平台(需翻墙),这几个就基本把国内搜索引擎用户占有完了。

网站验证的流程都很简单,一看站长平台的控制台就能明白,这里不细写了。接入站长平台最重要的作用无疑是告知搜索引擎:“可以派蜘蛛来抓取了”,除此以外站长平台里还有非常多能影响到 SEO 成效的功能,比如:sitemap 提交、robots.txt 检测、链接提交、原创内容提交、闭站保护等。

文末,说一说“闭站保护”。多数站长并没有那么充足的资源去执行系统的线下开发,要改什么文件直接下载到本地改完再上传,或者直接在线上修改,尤其在建站初期,由于专注于前端和后端的完善,长期没有新文章发布也是常事。这种情况下就要考虑申请“闭站保护”,其作用在于让搜索引擎暂停抓取和展现,有点像通告网站正处于调整期,根据百度官方的说明这个功能可以保留收录,而且不会使站点评分受到影响。